在剛剛過去的“雙十一”購物狂歡節中,阿里巴巴交易系統再次刷新了世界紀錄,成功支撐了每秒32.5萬筆的交易峰值。這一數字背后,是阿里巴巴自主研發的交易中間件框架TMF2.0(Taobao Middleware Framework)的強大技術支撐。本文將深入揭秘TMF2.0如何通過創新的架構設計和高性能技術棧,打造出能夠應對超大規模并發挑戰的下一代交易系統。

一、核心挑戰:超大規模并發下的系統穩定性與擴展性

實現32.5萬筆/秒的交易處理能力,絕非簡單的硬件堆砌。核心挑戰在于:

- 極致高并發:海量用戶在同一秒內創建訂單,對系統的線程、連接、鎖和計算資源構成巨大壓力。

- 數據強一致性:交易涉及資金和庫存,必須在分布式環境下保證數據的準確無誤,任何差錯都會導致資損。

- 復雜業務邏輯:交易并非簡單的“下單-扣款”,還耦合了優惠計算、庫存鎖定、風險防控、分賬等上百個業務步驟。

- 彈性伸縮:流量洪峰陡峭,系統必須能在分鐘級快速擴容,并在低谷時縮容以節約成本。

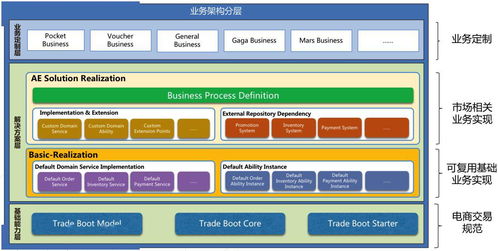

二、TMF2.0架構揭秘:從“框架”到“平臺”的演進

TMF2.0并非一個單一軟件,而是一個以業務為中心、高度可擴展的分布式交易技術平臺。其核心設計思想是:業務邏輯與技術架構解耦,通過標準化和組件化提升研發效率與系統性能。

1. 分層與插件化架構

TMF2.0將一次交易請求的處理流程標準化為清晰的層次:

- 網關層:統一接入,負責限流、路由、協議轉換。采用高性能網絡框架(如Netty),實現百萬級連接管理。

- 業務編排層:這是TMF2.0的核心。它將一個交易訂單的生成過程抽象為一條可視化的“業務流程管線”。每個業務步驟(如驗價、驗券、扣庫存)被封裝成一個獨立的業務插件(Biz Plugin)。開發人員無需關注線程、事務等底層技術,只需像拼裝樂高一樣編排插件順序。這種設計使得復雜業務邏輯的修改和擴展變得異常靈活。

- 核心服務層:提供原子化的領域服務,如會員服務、商品服務、庫存服務。這些服務被深度優化,實現無狀態化,便于水平擴展。

- 數據存儲層:采用混合存儲架構。

- 熱點庫存:采用自研的Tair(分布式緩存)或Redis集群,實現內存級扣減,保證超高并發下的性能。

- 訂單數據:基于阿里云PolarDB或自研OceanBase分布式數據庫,實現數據的分庫分表和彈性伸縮,同時保證強一致性和高可用性。

2. 高性能關鍵技術

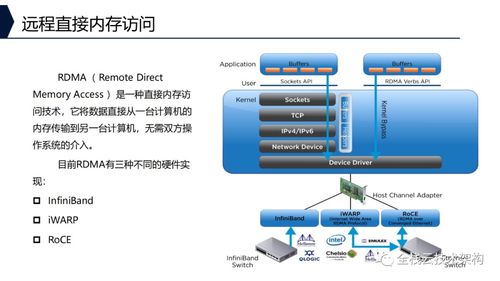

- 異步化與響應式編程:全鏈路采用異步非阻塞模型。從網絡IO到數據庫訪問,避免線程阻塞,用更少的資源承載更高的并發。業務插件之間也通過異步消息進行松耦合通信。

- 熱點數據與緩存治理:

- 本地緩存:在業務服務器本地緩存極少變化的靜態數據(如商品類目),減少遠程調用。

- 分布式緩存:對熱點商品庫存進行“緩存預熱”和“動態分區”,防止單點過熱。

- 一致性保障:通過“寫數據庫后異步淘汰緩存”、“緩存雙讀”等策略,在保證性能的最大限度保障數據正確性。

- 分布式事務優化:針對交易場景,大量采用“最終一致性”方案。例如,創建訂單時先快速扣減緩存庫存并生成訂單,再異步同步至數據庫。對于必須強一致的環節(如支付),則使用優化的TCC(Try-Confirm-Cancel)模式或基于消息隊列的事務消息,減少全局鎖持有時間。

- 全鏈路壓測與彈性伸縮:

- 混沌工程:在生產環境定期進行故障注入演練,驗證系統的容錯能力。

- 全鏈路壓測:通過技術手段在線上真實數據庫和系統中模擬“雙十一”量級的流量,提前發現瓶頸。

- 基于Kubernetes的彈性調度:配合阿里云容器服務,系統能夠根據CPU負載、QPS等指標自動擴容應用實例,實現秒級響應。

3. 智能化運維與監控

- 可觀測性體系:集成Metrics(指標)、Tracing(鏈路追蹤)、Logging(日志)三大支柱。任何一筆交易都能在全鏈路中被實時追蹤和監控。

- 智能限流與降級:實時監控系統負荷,自動識別非核心服務(如商品評價)并實施熔斷降級,保障訂單、支付等核心鏈路的絕對暢通。

- 容量規劃:基于歷史數據和機器學習模型,對未來的流量峰值進行精準預測,提前完成資源規劃和調度。

三、TMF2.0帶來的啟示

阿里交易系統TMF2.0的成功,標志著大規模互聯網系統架構從“堆機器”的粗放模式,進入了“精細化技術運營”的新階段。其精髓在于:

- 平臺化思維:將通用技術能力沉淀為平臺,讓業務開發聚焦創新。

- 極致性能優化:從每一行代碼、每一次網絡調用、每一個數據庫事務中挖掘性能潛力。

- 彈性與穩定并重:通過自動化和智能化,使系統具備“反脆弱”能力,在沖擊中愈加強健。

32.5萬筆/秒,不僅是一個數字,更是分布式系統架構、軟件工程和運維技術深度融合的里程碑。TMF2.0所展現的技術路徑,為全球電子商務乃至所有需要處理高并發交易的行業,提供了極具價值的參考范式。